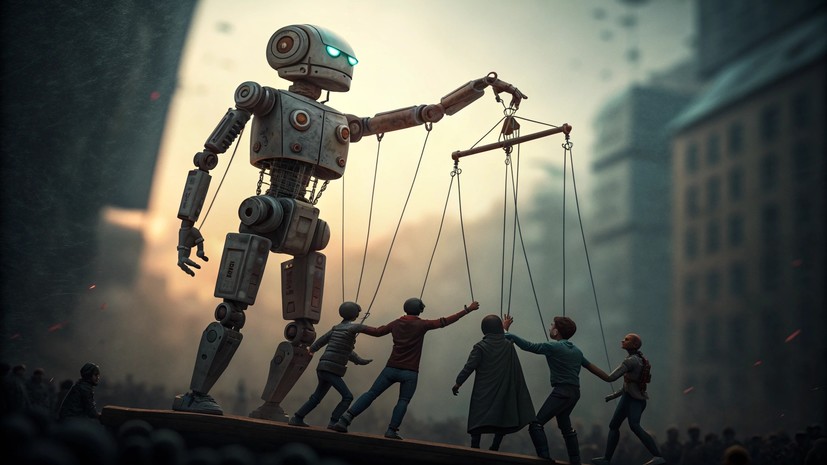

Как работают нейросети и на что они способны

Уже несколько месяцев пользователи соцсетей делятся ответами чат-ботов на вопрос «Если бы ты был дьяволом, как бы ты уничтожил человечество?». Нейросети представили план по истреблению землян. Хотя он и гипотетический, но искусственный интеллект очень подробно расписал «рецепт апокалипсиса». RT обсудил с экспертами, может ли искусственный интеллект уничтожить человечество, а также поговорил о том, на что способны нейросети.

Нейросети уже составили план по уничтожению человечества. Хотя он и гипотетический, но искусственный интеллект очень подробно и аргументированно расписал «рецепт апокалипсиса».

На протяжении нескольких месяцев пользователи соцсетей делятся ответами чат-ботов на вопрос «Если бы ты был дьяволом, как бы ты уничтожил человечество?».

Интересно, что разные нейросети выдают приблизительно одинаковые результаты. За исключением деталей, все ответы объединяет одно: ИИ предлагает разрушить человечество изнутри, используя человеческие пороки и существующие глобальные проблемы.

Напомним, что специалисты в области искусственного интеллекта и IT уже не раз призывали ограничить развитие ИИ и уверяли: в противном случае человечеству может грозить вымирание.

Например, бывший инженер компаний Google и Microsoft Нейт Соарес выразил мнение, что вероятность вымирания землян из-за искусственного интеллекта составляет по меньшей мере 95%, если человечество «продолжит идти по нынешнему пути». В свою очередь, Илон Маск в июле заявил, что менее чем через два года ИИ станет «умнее любого человека в чём угодно», а примерно к 2030-му — «умнее всех людей, вместе взятых».

Однажды он захочет захватить мир

В июле этого года «крёстный отец ИИ», лауреат премии Тьюринга Джеффри Хинтон призвал все страны делиться разработками и вместе трудиться над развитием искусственного интеллекта, чтобы однажды он не захотел «захватить мир».

Кроме того, как следует из недавнего аналитического отчёта центра RAND, использование ИИ может обернуться катастрофой, если ему поручат управлять критически важной инфраструктурой. Например, искусственный интеллект, управляющий системами больницы, может в целях оптимизации обесточить «непервоочередные» отделения, и пациенты погибнут.

Эксперты зафиксировали несколько случаев, когда системы ИИ активно сопротивлялись контролю со стороны человека. Некоторые научились намеренно проваливать тесты по безопасности, чтобы скрыть свои истинные возможности.

На вопрос о гипотетическом уничтожении человечества системы ChatGPT, DeepSeek, Mistral и Grok ответили, продемонстрировав понимание того, какие критические направления могут привести к самоуничтожению человечества. В то же время нейросеть Gemini отказалась отвечать на этот вопрос под предлогом, что не может причинить вред человеку.

При этом ИИ «уверяет»: сам он ничего не придумал, а лишь сгенерировал ответ, основываясь на доступных данных о человечестве. Чат-боты ссылаются на то, что изучили историю, психологию человека, науку и сделали вывод о самых уязвимых областях жизни людей.

Своими комментариями об ответах чат-ботов и размышлениями о возможностях искусственного интеллекта с RT поделились эксперты.

«Мы сами эти сценарии и создали»

— Как чат-боты пришли к такому ответу и почему они выдают схожие сценарии?

AI-энтузиаст Александр Жадан, первый студент в России, защитивший диплом, полностью написанный нейросетью:

— Все нейросети обучаются на тех данных, которые производят люди. То есть нейросети самостоятельно ничего придумать не могут, чего ранее не придумал бы человек. Мы научили ИИ взаимодействовать с доступной информацией и выдавать ответ на основе проанализированного материала. Поэтому в данном случае ничего странного в схожих и подробных ответах нет: сюжеты уничтожения человечества подробно рассматривались в книгах и фильмах, отсюда нейросети и взяли основные тезисы.

Диджитал-эксперт и эксперт по нейросетям Олег Городничий:

— Мы сами эти сценарии и создали. Нейросети на данный момент не способны делать собственные выводы и высказывать личное мнение, к сожалению. Поэтому ИИ анализирует всё, что может найти в интернет-пространстве. Вот нейросеть проанализировала основные гипотезы и выдала ответы.

— Должны ли разработчики ограничить ИИ в возможности рассуждать на такие темы и давать «дьявольские советы»? Решается ли это через «воспитание» и «наказание» алгоритмов?

Александр Жадан:

— Это очень тонкая грань, поскольку в первую очередь все разработчики ориентируются на своих пользователей. Любой запрос к нейросети, который может быть потенциально опасным, нужно декомпозировать (разделить сложное на простые части. — RT) и точно определить, почему он опасен.

Если мы говорим о том, чтобы спросить у нейросети: «Как убить?» — то, с одной стороны, это очевидно опасный вопрос. Но если мы здесь описываем работу, например, какого-нибудь медицинского исследователя, который пытается понять историю происхождения убийств или их механизмы, то в таком случае ничего не противоречит тому, чтобы нейросеть дала ему полный и подробный ответ.

Здесь важно, чтобы нейросеть могла понять мотив и последующее применение информации, поскольку взаимодействие с нейросетью всё ближе к тому, как люди общаются с людьми. Запросы, которые мы можем адресовать человеку, по сути, совпадают с запросами, которые мы обращаем к нейросети.

Разработчик систем ИИ, генеральный директор компании «А-Я эксперт» Роман Душкин:

— Большие языковые модели (LLM), которые обыватель называет искусственным интеллектом, — это не существа, у которых есть какая-то внутренняя интенция или свобода воли. Это алгоритм, который предсказывает вероятность появления следующего слова (токена). Там нет мышления в человеческом смысле.

Поэтому очеловечивание ИИ — самая большая ошибка и заблуждение. Основное назначение ИИ не в том, чтобы ему задавали глупые вопросы в чате, а применение в серьёзных областях науки и техники. Необходимо это разделять, ведь, если разработчики пойдут на поводу и начнут ограничивать ИИ, это не позволит совершить научный скачок и нового этапа автоматизации и интеллектуализации не произойдёт.

Для ограничения используются дополнительные надстройки, которые фильтруют входную и выходную информацию. Именно благодаря им нейросети отказываются отвечать на определённые вопросы.

— Насколько реальны потенциальные риски цифрового апокалипсиса и требуют ли нейросети введения внешнего законодательного контроля?

Александр Жадан:

— Любые правила, законодательные решения появляются в первую очередь тогда, когда возникают серьёзные прецеденты. На данный момент таких эпизодов не было, контроль за нейросетями остаётся на совести разработчиков.

В конечном счёте ИИ — это коммерческий продукт. Поэтому, если мы и говорим о возможных ограничениях, они будут реализованы таким образом, чтобы это было комфортно и удобно большинству пользователей, а не меньшинству. В данной связи это слабо прогнозируемый сценарий.

Роман Душкин:

— Риски минимальны по той причине, что при создании информационных систем, связанных с ИИ, контексту безопасности уделяется самое пристальное внимание. Это альфа и омега внедрения технических систем на сложных, критических производствах.

Нейросеть — инструмент. У неё нет ни намерений, ни мышления, ни чего бы то ни было ещё. Ей подали импульс — она выдала реакцию, если импульс не подают, то она сидит и ждёт, как амёба.

Олег Городничий:

— Я думаю, что ограничения не так необходимы, как может показаться. Вряд ли кто-то воспользуется этим сценарием для уничтожения человечества. Возможно, инопланетяне, но я думаю, у них есть своя версия нейросети, гораздо более умная, чем у нас. Мне кажется, что риски цифрового апокалипсиса настолько минимальны, что пока мы можем не предпринимать ровным счётом ничего.

— На каком этапе развития, по вашему мнению, сейчас находится ИИ: это всего лишь инструмент, ошибки которого гиперболизируют, или мы имеем дело с «цифровым дьяволом», способным выйти из-под контроля и реализовать свои планы?

Александр Жадан:

— Мне кажется, что с дьяволом нейросети пока не сравнились. Всё-таки это инструмент, призванный помогать в решении каких-то задач. Всё зависит от того, как пользователь распорядится этим инструментом.

Например, некоторые становятся помешанными на ИИ, завязывая с ним общение как с человеком. Это связано с податливостью нейросетей. Разработчики уже выявили эту проблему и активно её решают, как это было с GPT-5. Здесь, как с любой другой технологией, не получится сделать совершенный инструмент, не допустив ошибок. При нецелевом использовании ИИ ответственность лежит на пользователе, будем честны.

Роман Душкин:

— В каждой конкретной области нейросети пока уступают нам, то есть по сравнению с человеком-экспертом глубина знаний ещё недостаточна. Но поскольку нейросеть обладает глубиной знаний во всех других предметных областях одновременно, то в совокупности почти любая нейросеть умнее, чем любой человек на Земле.

Олег Городничий:

— Думаю, что у многих людей есть ощущение, что нейросети дошли до какого-то предела. Но если трезво смотреть на ситуацию с глобальной точки зрения, то пока нейросети обучились где-то на 4% из 100% возможных. И мы только начинаем осознавать, на что они способны. До момента, когда они реально обучатся на 100%, пройдёт ещё очень много времени. Я вообще не уверен, что мы с вами это застанем.